發(fā)布時(shí)間:2017/5/24 20:34:41 來(lái)源:人民網(wǎng) 編輯:中國(guó)家裝家居網(wǎng)

概要:機(jī)器學(xué)習(xí)算法和人工智能系統(tǒng)正影響著人們生活的許多領(lǐng)域——瀏覽新聞、觀看電影、獲取信貸,甚至資本投資。

智庫(kù)跟蹤 | 蘭德:人工智能的偏差和錯(cuò)誤風(fēng)險(xiǎn)

前言:機(jī)器學(xué)習(xí)算法和人工智能系統(tǒng)正影響著人們生活的許多領(lǐng)域——瀏覽新聞、觀看電影、獲取信貸,甚至資本投資。出于對(duì)效率和速度的考慮,算法已經(jīng)有權(quán)在這些領(lǐng)域作出決定并采取行動(dòng)。當(dāng)然,它也給人們帶來(lái)了就業(yè)方面的擔(dān)憂(yōu)。蘭德公司在報(bào)告中闡述了算法決策的一些缺點(diǎn),包括算法錯(cuò)誤和偏差問(wèn)題,并研究了解決這些問(wèn)題的一些方法。報(bào)告強(qiáng)調(diào)了在公共政策中使用算法決策所固有的風(fēng)險(xiǎn)和復(fù)雜性,指出技術(shù)與非技術(shù)方法的結(jié)合可能是最需要的補(bǔ)救措施。

機(jī)器學(xué)習(xí)算法和人工智能系統(tǒng)正影響著人們生活的許多領(lǐng)域——瀏覽新聞、觀看電影、獲取信貸,甚至資本投資。出于對(duì)效率和速度的考慮,算法已經(jīng)有權(quán)在這些領(lǐng)域作出決定并采取行動(dòng)。當(dāng)然,它也給人們帶來(lái)了就業(yè)方面的擔(dān)憂(yōu)。蘭德公司在報(bào)告中闡述了算法決策的一些缺點(diǎn),包括算法錯(cuò)誤和偏差問(wèn)題,并研究了解決這些問(wèn)題的一些方法。

報(bào)告第一章介紹了隨著人工智能的發(fā)展,算法偏差和錯(cuò)誤風(fēng)險(xiǎn)不斷增加。第二章定義并仔細(xì)審議了算法的概念,重點(diǎn)關(guān)注了復(fù)雜算法中的不正確或不公平行為,側(cè)重于人工智能對(duì)社會(huì)和政策的影響。第三章關(guān)注的是算法底層的錯(cuò)誤行為,而不是特例,提出了解決這些問(wèn)題的可選方案,以及算法決策過(guò)程的問(wèn)責(zé)措施,包括最近發(fā)展的有關(guān)公平、可測(cè)量和透明的機(jī)器學(xué)習(xí)。第四章給出了一些如何了解和加強(qiáng)應(yīng)對(duì)算法偏差挑戰(zhàn)的觀察和建議。

一、算法的定義和評(píng)估

1、定義

經(jīng)過(guò)幾個(gè)世紀(jì)的發(fā)展,算法的定義也發(fā)生了很大的變化。最初,算法關(guān)注的是可靠的一步一步的程序計(jì)算;后來(lái)引入了可計(jì)算性和可計(jì)算功能,形成了算法思想;再后來(lái)引入了學(xué)習(xí)算法,在微觀層面引入了機(jī)械的順序計(jì)算程序,許多最初的算法試圖模仿生物行為。人工智能最大的目標(biāo)是使用先進(jìn)的學(xué)習(xí)算法,建立自動(dòng)人工智能的能力,使其超過(guò)人類(lèi)的智能。

人工智能先驅(qū)的工作為機(jī)器學(xué)習(xí)算法奠定了基礎(chǔ),是今天使用的絕大部分自動(dòng)系統(tǒng)的根基。這些自動(dòng)化系統(tǒng)通常專(zhuān)注于學(xué)習(xí)解決“簡(jiǎn)單”的任務(wù),如自動(dòng)語(yǔ)音和圖像識(shí)別。該系統(tǒng)的常見(jiàn)術(shù)語(yǔ)為狹義人工智能。舉個(gè)例子,這些工作是最先進(jìn)的深度學(xué)習(xí)技術(shù)(用于現(xiàn)代圖像和語(yǔ)音識(shí)別)的基礎(chǔ)。

正在進(jìn)行的“大數(shù)據(jù)”革命也被看作促進(jìn)學(xué)習(xí)算法廣泛應(yīng)用的有力催化劑。大數(shù)據(jù)提供了源源不斷的多模數(shù)據(jù),這對(duì)通過(guò)學(xué)習(xí)算法提取有價(jià)值的洞察力是必需的。使用強(qiáng)大的算法是唯一能夠弄懂日常數(shù)量、種類(lèi)龐雜的數(shù)據(jù)的可持續(xù)的方法。

算法的文化概念往往混雜了從盲目的計(jì)算程序(如靜態(tài)計(jì)算)到高級(jí)的自動(dòng)學(xué)習(xí)與推理程序(用于諸如IBM沃森的系統(tǒng))的全譜算法。這種算法的文化概念就像草率的速記,鼓勵(lì)公眾將算法看作一個(gè)整體的、不透明的、近似神學(xué)的構(gòu)造。許多影響公共生活的關(guān)鍵算法也被認(rèn)為是專(zhuān)利或商業(yè)秘密。這種對(duì)于算法不透明、不知情的理解妨礙了公眾在人工智能方面的話(huà)語(yǔ)權(quán)。

然而,學(xué)習(xí)算法是一個(gè)有些不同的存在。它同時(shí)具有實(shí)施的正確性功能(算法設(shè)計(jì)者傾向于關(guān)注的內(nèi)容)和學(xué)習(xí)行為的正確性功能(用戶(hù)關(guān)心的內(nèi)容)。最近的一個(gè)例子就是微軟的人工智能聊天機(jī)器人——Tay。Tay背后的算法使得其能在與推特用戶(hù)的交流過(guò)程中使人信服。而其在受控環(huán)境中的廣泛測(cè)試并沒(méi)有引起軒然大波。Tay行為的一個(gè)重要特征是通過(guò)攝取用戶(hù)數(shù)據(jù)來(lái)學(xué)習(xí)和響應(yīng)用戶(hù)的傾向。這個(gè)特征使得推特用戶(hù)有可能操縱Tay的行為,使其發(fā)表一系列的攻擊性言語(yǔ)。無(wú)論是其經(jīng)驗(yàn)還是數(shù)據(jù)都沒(méi)有考慮到新的上下文語(yǔ)境的新意。

這種類(lèi)型的漏洞不是唯一的例子。學(xué)習(xí)算法往往容易受到訓(xùn)練數(shù)據(jù)的影響。這些算法的特點(diǎn)就是具有適應(yīng)變化的輸入數(shù)據(jù)的能力。但算法對(duì)于響應(yīng)輸入數(shù)據(jù)的適配同時(shí)也為惡意用戶(hù)提供了一個(gè)攻擊途徑。在學(xué)習(xí)算法中,數(shù)據(jù)攝取漏洞是一個(gè)反復(fù)出現(xiàn)的問(wèn)題。

2、算法的“不端行為”審議

隨著人工智能體在決策過(guò)程中發(fā)揮的作用越來(lái)越大,更應(yīng)關(guān)注它容易出現(xiàn)的錯(cuò)誤及“不端行為”。

“行為不端”的算法,是對(duì)導(dǎo)致不正確、不公平或危險(xiǎn)的后果的人工智能體的一種隱喻。最初,它是指使用計(jì)算機(jī)系統(tǒng)完成各種任務(wù)的偏差,包括工作日程管理、就業(yè)匹配、航線(xiàn)路徑規(guī)劃、移民法律援助自動(dòng)化等。

算法系統(tǒng)在半自動(dòng)商業(yè)預(yù)定系統(tǒng)(SABRE)和國(guó) 家居 民匹配項(xiàng)目(醫(yī)療方面)的使用中都出現(xiàn)了偏差和問(wèn)題。互聯(lián)網(wǎng)的發(fā)展和個(gè)人計(jì)算機(jī)的廣泛使用,擴(kuò)大了這些問(wèn)題的范圍。算法開(kāi)始更多地介入我們與信息之間的互動(dòng)。谷歌就是一個(gè)典型的案例。谷歌的搜索和廣告投放算法消化了大量用戶(hù)生成的數(shù)據(jù)來(lái)優(yōu)化用戶(hù)(包括普通用戶(hù)和廣告商)服務(wù)。這樣的系統(tǒng)首先暴露了學(xué)習(xí)算法對(duì)廣泛個(gè)人消費(fèi)的分析結(jié)果。

研究顯示,谷歌搜索和廣告算法系統(tǒng)存在“算法誹謗”,會(huì)不正確地關(guān)聯(lián)人或群體,這些不正確的關(guān)聯(lián)影響了谷歌精準(zhǔn)投放廣告業(yè)務(wù)。例如,僅僅是搜索某種類(lèi)型的名詞就會(huì)導(dǎo)致推送刑事司法服務(wù)方面的廣告。

在新興的數(shù)據(jù)和算法新聞?lì)I(lǐng)域,許多錯(cuò)誤的算法影響了人們線(xiàn)上/線(xiàn)下生活的方方面面。IBM著名的“危險(xiǎn)”AI沃森,在其學(xué)習(xí)算法攝入一些不好的數(shù)據(jù)后也不得不人為糾正其說(shuō)臟話(huà)的習(xí)慣。還有一些報(bào)告揭示了Waze交通路由算法在城市交通模式中的負(fù)面影響。

另外一些研究關(guān)注治理、公共政策和復(fù)雜的社會(huì)問(wèn)題中算法的影響。在這些領(lǐng)域里,人工智能體不得不面對(duì)另一個(gè)層面的復(fù)雜性和危險(xiǎn)——其不良表現(xiàn)將產(chǎn)生深遠(yuǎn)、大范圍、波及世代的后果。

有報(bào)告說(shuō)明了算法決策在法律領(lǐng)域的傳播是如何剝奪公民正當(dāng)權(quán)益的。最近的報(bào)告顯示了全國(guó)量刑聽(tīng)證中廣泛使用的刑事風(fēng)險(xiǎn)評(píng)估算法中出現(xiàn)了嚴(yán)重的系統(tǒng)偏差。

最近一篇有影響力的文章探討了大數(shù)據(jù)是否會(huì)導(dǎo)致算法公平或中立行為這個(gè)最根本的問(wèn)題,認(rèn)為如果不改革大數(shù)據(jù)和相關(guān)算法的應(yīng)用,答案是明確的否定。

有專(zhuān)家在論文中討論了算法和大數(shù)據(jù)如何規(guī)避我們所能預(yù)料的法律隱私風(fēng)險(xiǎn)。標(biāo)準(zhǔn)的避免算法偏差影響的方法是從學(xué)習(xí)算法中隱藏敏感數(shù)據(jù)字段(如性別和種族)。

最近,算法設(shè)計(jì)者和研究人員已開(kāi)始通過(guò)技術(shù)方法,認(rèn)證和消除算法偏差的影響。

3、案例研究:刑事司法制度中的人工智能

美國(guó)刑事司法系統(tǒng)越來(lái)越多地訴諸算法工具。人工智能代理有助于減輕管理這樣一個(gè)大系統(tǒng)的負(fù)擔(dān)。但這些工具中任何系統(tǒng)算法偏差都會(huì)帶來(lái)很高的錯(cuò)誤及其累計(jì)風(fēng)險(xiǎn)。

人工智能算法已經(jīng)用于全國(guó)各地的量刑假釋聽(tīng)證系統(tǒng)。但是,這個(gè)系統(tǒng)將黑人罪犯的評(píng)級(jí)定為高于非黑人——即使非黑人犯有有更嚴(yán)重的罪行。這暗示了一個(gè)系統(tǒng)性的種族偏見(jiàn)。

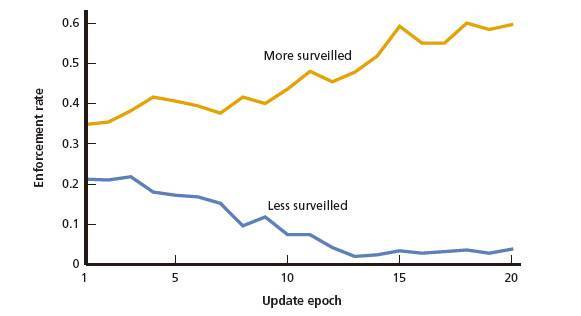

警察部門(mén)也開(kāi)始將工作訴諸預(yù)測(cè)警務(wù)和分配資源的算法工具。雖然該算法是合理有效的,但也不能避免導(dǎo)致不公平的結(jié)果。

二、 重點(diǎn)問(wèn)題:影響因素和補(bǔ)救措施

上文分析了算法出現(xiàn)偏差的角度主要有三種:第一個(gè)也是最基本的角度是數(shù)據(jù)的攝取問(wèn)題,關(guān)鍵是在學(xué)習(xí)中要考慮人類(lèi)活動(dòng)本身會(huì)存在偏差——學(xué)習(xí)包括好的和壞的兩方面;第二個(gè)角度是,應(yīng)用于政策或社會(huì)問(wèn)題時(shí),很難定義基本事實(shí)和確定強(qiáng)有力的指導(dǎo)原則,除了對(duì)性能指標(biāo)進(jìn)行優(yōu)化,學(xué)習(xí)算法還需要將社會(huì)可接受性措施進(jìn)行優(yōu)化;第三個(gè)角度是,在社會(huì)行為空間中進(jìn)行的判斷往往是模糊的,不是非黑即白的兩元標(biāo)準(zhǔn)。

有一個(gè)已經(jīng)發(fā)展了數(shù)世紀(jì)的系統(tǒng)可以應(yīng)對(duì)受制于模糊的社會(huì)規(guī)范和互相矛盾的報(bào)告或數(shù)據(jù)而產(chǎn)生的政策問(wèn)題,那就是法律。有專(zhuān)家指出,雖然加密貨幣和算法(“智能”)協(xié)議可能優(yōu)于執(zhí)行二元產(chǎn)權(quán),但其在現(xiàn)實(shí)世界中的產(chǎn)權(quán)是模糊的、有爭(zhēng)議的。類(lèi)似的情況也出現(xiàn)在我們認(rèn)為合理的算法——算法行為有時(shí)被定義得并不準(zhǔn)確。法律已經(jīng)演變?yōu)閷?duì)模糊復(fù)雜事務(wù)的審判。

美國(guó)法律也承認(rèn),表面上合理的程序可能會(huì)產(chǎn)生不利的、與預(yù)期完全不同的影響。對(duì)于產(chǎn)生這種與預(yù)期完全不同的影響的理解僅僅是在算法研究界慢慢傳播。

1、 其它技術(shù)因素

(1)樣本大小差異

機(jī)器學(xué)習(xí)算法是統(tǒng)計(jì)估計(jì)方法。這些方法估計(jì)誤差的措施通常與數(shù)據(jù)樣本大小成反比。這意味著對(duì)于低代表性的事件種類(lèi),這些方法通常會(huì)更容易出錯(cuò)。

(2)被欺騙的獎(jiǎng)勵(lì)功能

機(jī)器學(xué)習(xí)和人工智能理論中的獎(jiǎng)勵(lì)功能來(lái)自行為心理學(xué)習(xí),是目前人工學(xué)習(xí)系統(tǒng)學(xué)習(xí)正確行為的主要手段。在人工智能學(xué)習(xí)過(guò)程中,獎(jiǎng)勵(lì)功能量化了我們對(duì)其行動(dòng)和決定的獎(jiǎng)懲。學(xué)習(xí)這些算法,然后適應(yīng)人工智能體的參數(shù)和行為,就可以以最大限度地提高其總回報(bào)。因此,人工智能行為設(shè)計(jì)往往將設(shè)計(jì)減少到足夠激勵(lì)獎(jiǎng)勵(lì)功能的程度,而這種行為主義的學(xué)習(xí)方式可以被欺騙。

(3)文化差異

機(jī)器學(xué)習(xí)算法通過(guò)選擇電訊或與各種行為相關(guān)聯(lián)的數(shù)據(jù)中的顯著特征(變量)來(lái)工作。文化調(diào)和的行為可能導(dǎo)致不公平行為發(fā)生。

(4)混雜的變量

算法設(shè)計(jì)者通常選擇從其處理過(guò)的數(shù)據(jù)中刪除敏感變量,試圖使系統(tǒng)結(jié)果無(wú)偏差。系統(tǒng)設(shè)計(jì)師的一個(gè)常見(jiàn)的說(shuō)法是,“系統(tǒng)不會(huì)有偏差,因?yàn)樗鼪](méi)有考慮(一些敏感的變量)。”機(jī)器學(xué)習(xí)方法經(jīng)常通過(guò)概率推斷隱藏變量。而研究表明,傳統(tǒng)的數(shù)據(jù)隱私和匿名方法不再可行,這是因?yàn)楝F(xiàn)代的機(jī)器學(xué)習(xí)算法能夠“簡(jiǎn)單粗暴”地重新識(shí)別數(shù)據(jù)。

2、補(bǔ)救措施

(1) 統(tǒng)計(jì)方法和算法

目前有一個(gè)不斷發(fā)展的領(lǐng)域,專(zhuān)注于公平、負(fù)責(zé)任、透明的機(jī)器學(xué)習(xí),致力于采用技術(shù)途徑保證算法公平及認(rèn)證并糾正機(jī)器學(xué)習(xí)算法中偏差的影響。

有專(zhuān)家建議在使用主觀數(shù)據(jù)時(shí),使用修正度量或相似度計(jì)算。在比較數(shù)據(jù)集中的主觀數(shù)據(jù)時(shí),這些相似度計(jì)算意味著執(zhí)行嚴(yán)格的公平性約束。一些專(zhuān)家提出了若干算法審計(jì)程序,將算法輸出與期望的公平行為進(jìn)行比較。

(2) 因果推理算法

在更廣泛的、更長(zhǎng)的時(shí)間范圍內(nèi),一些專(zhuān)家正在探索將因果或反事實(shí)推理用于機(jī)器學(xué)習(xí)算法中。這是非常重要的,因?yàn)樽詣?dòng)因果推理系統(tǒng)在判斷算法決策過(guò)程的質(zhì)量時(shí),可呈現(xiàn)清晣的因果敘述。算法決策的精確因果推理是最可靠的審計(jì)跟蹤算法。對(duì)偶然因素進(jìn)行審計(jì)的算法,可為結(jié)論提供更清楚的解釋或理由。這對(duì)判斷系統(tǒng)的不當(dāng)結(jié)果(統(tǒng)計(jì)學(xué)不相稱(chēng)結(jié)果)是至關(guān)重要的。

(3) 算法素養(yǎng)和透明度

在對(duì)抗算法偏差方面,使受過(guò)良好教育的公眾理解算法可能會(huì)導(dǎo)致不公平的結(jié)果將是有益的。這與要求用戶(hù)了解所有算法的內(nèi)部工作原理(顯然不可行)是不一樣的。只需灌輸一種健康的“知情懷疑論”,對(duì)減少自動(dòng)化偏差帶來(lái)的影響就可能已經(jīng)足夠。

將算法素養(yǎng)和透明度結(jié)合起來(lái)可能非常有效。在這里,透明度通常是指確保使用中的任何算法都容易被理解——這并不是一直可行的。將由人工智能體經(jīng)手處理的決策和實(shí)施行動(dòng)進(jìn)一步公開(kāi)應(yīng)該是可行和有用的。

(4) 人事方法

對(duì)于機(jī)器學(xué)習(xí)和人工智能算法中偏差的技術(shù)研究仍處于初級(jí)階段。算法中的偏差和系統(tǒng)錯(cuò)誤問(wèn)題,可能取決于算法設(shè)計(jì)者和數(shù)據(jù)科學(xué)家與眾不同的思維方式。這些從業(yè)者通常是較少接觸社會(huì)或公共政策問(wèn)題的工程師和科學(xué)家。算法設(shè)計(jì)人員的構(gòu)成往往缺乏多樣性。這些算法設(shè)計(jì)者作出了大量的設(shè)計(jì)選擇,其中一些可能會(huì)產(chǎn)生深遠(yuǎn)的影響。算法開(kāi)發(fā)人員的多樣性有助于提高對(duì)潛在的各類(lèi)問(wèn)題的敏感性。

雖然如此,彌補(bǔ)算法偏差的驅(qū)動(dòng)力應(yīng)該在健康的監(jiān)管約束中得到鍛煉。任何一種補(bǔ)救措施都需要算法更緊密地遵守社會(huì)定義的價(jià)值觀,包括言論自由、審查制度、公平或其它可接受的道德標(biāo)準(zhǔn)等。

三、結(jié)論

本文說(shuō)明了算法的各種不同影響帶來(lái)的挑戰(zhàn),為什么我們希望擴(kuò)展“算法依賴(lài)”,以及可能減輕未來(lái)風(fēng)險(xiǎn)的最佳選擇是什么。只要人工智能體在我們生活中扮演著越來(lái)越重要的角色并且不受監(jiān)管,算法和人工智能的錯(cuò)誤與偏差風(fēng)險(xiǎn)將繼續(xù)存在。

應(yīng)對(duì)不受管制的人工智能體趨向三大類(lèi)方法:完全避免算法、使底層算法透明、對(duì)算法輸出進(jìn)行審計(jì)。完全避免算法幾乎是不可能的,沒(méi)有其它方法可以處理當(dāng)前的數(shù)據(jù)洪流。算法透明則需要讓更多受過(guò)教育的公眾能夠理解算法。但深度聯(lián)結(jié)學(xué)習(xí)的最新進(jìn)展表明,即使我們可以解構(gòu)一個(gè)算法的流程,對(duì)于獲得有用的感知它可能仍然過(guò)于復(fù)雜。

有學(xué)者最近的研究認(rèn)為,第三種選擇——算法審計(jì)——可能是前進(jìn)的方向。某些審計(jì)忽略了人工智能體內(nèi)部的工作,并根據(jù)結(jié)果的公平性進(jìn)行判斷。這與我們經(jīng)常對(duì)人類(lèi)的判斷類(lèi)似:由其輸出(決策和行動(dòng)),而不是內(nèi)容和代碼庫(kù)的獨(dú)特性(思想)決定。這一選擇對(duì)政策制定者最有幫助,而且為人工智能體建立了一個(gè)結(jié)果主義道德標(biāo)準(zhǔn)。在這一框架下,監(jiān)管就會(huì)變得更加容易。

像這樣的討論有時(shí)會(huì)人格化人工智能體:機(jī)器是否開(kāi)始像我們一樣思考?我們?nèi)绾闻袛嗪鸵龑?dǎo)他們?人工智能體目前的進(jìn)展可能會(huì)使算法人格化的觀點(diǎn)更加普遍。這可能對(duì)培育公眾不基于偏見(jiàn),像理解人類(lèi)一樣理解人工智能體,產(chǎn)生意想不到的好處。

內(nèi)容框架

第一章 介紹

第二章 算法:定義與評(píng)估

1、 算法定義

2、 “行為不端”的算法:一個(gè)簡(jiǎn)要的評(píng)議

3、 案例研究:刑事司法制度中的人工智能體

第三章 重點(diǎn)問(wèn)題:影響因素和補(bǔ)救措施

1、 其它技術(shù)因素

2、 補(bǔ)救措施

第四章 結(jié)論

關(guān)鍵圖表

圖1 每級(jí)事件執(zhí)行率:兩個(gè)亞群,相同犯罪率、不同警戒級(jí)別

歡迎企業(yè)家加入未來(lái)科技學(xué)院,共同提升企業(yè)科技競(jìng)爭(zhēng)力

一日千里的科技進(jìn)展,層出不窮的新概念,使企業(yè)家,投資人和社會(huì)大眾面臨巨大的科技發(fā)展壓力,前沿科技現(xiàn)狀和未來(lái)發(fā)展方向是什么?現(xiàn)代企業(yè)家如何應(yīng)對(duì)新科學(xué)技術(shù)帶來(lái)的產(chǎn)業(yè)升級(jí)挑戰(zhàn)?

未來(lái)科技學(xué)院將通過(guò)舉辦企業(yè)家與科技專(zhuān)家研討會(huì),未來(lái)科技學(xué)習(xí)班,企業(yè)家與科技專(zhuān)家、投資人的聚會(huì)交流,企業(yè)科技問(wèn)題專(zhuān)題研究會(huì)等多種形式,幫助現(xiàn)代企業(yè)通過(guò)前沿科技解決產(chǎn)業(yè)升級(jí)問(wèn)題、開(kāi)展新業(yè)務(wù)拓展,提高科技競(jìng)爭(zhēng)力。

未來(lái)科技學(xué)院由人工智能學(xué)家在中國(guó)科學(xué)院虛擬經(jīng)濟(jì)與數(shù)據(jù)科學(xué)研究中心的支持下建立,成立以來(lái),已經(jīng)邀請(qǐng)國(guó)際和國(guó)內(nèi)著名科學(xué)家、科技企業(yè)家300多人參與學(xué)院建設(shè),并建立覆蓋2萬(wàn)余人的專(zhuān)業(yè)社群;與近60家投資機(jī)構(gòu)合作,建立了近200名投資人的投資社群。開(kāi)展前沿科技講座和研討會(huì)20多期。 歡迎行業(yè)、產(chǎn)業(yè)和科技領(lǐng)域的企業(yè)家加入未來(lái)科技學(xué)院